Первая итерация этой статьи вышла 19 июня 2020 года в блоге multimedia world на портале MEDIUM (ныне заблокированном для РФ аудитории). Написана она была мной (Евгений Степанов, DevDir New Media) в эпоху работы директором по развитию мультимедиа студии dreamlaser.

Статья богата кейсами, отсылками к первоисточникам и в целом поможет читателю понять насколько богат, широк и разнообразен мир в разрезе всего одной технологии трекинга мультимедиа для проекции. Ценность материала за прошедшие 4 года не изменилась, поэтому я решил её переиздать, обновив ссылки на уже недоступные материалы, и сделать снова доступной широким массам.

Стоит отметить, что на момент публикации, в 2020 году, достижения технологии трекинга проекции выглядели невероятно полезными и перспективными. В тот пандемийный год они должны были предстать перед всем миром, массово применяясь на олимпиаде в Пекине, которая не состоялась.

Триумфа не вышло, а ещё с тех пор LED-экраны стали на порядок функциональнее и доступнее, затмив собой возможности проекции настолько, что технология похоже встала на паузу и не пошла в массы.

Трекинг мультимедиа BLACK TRAX

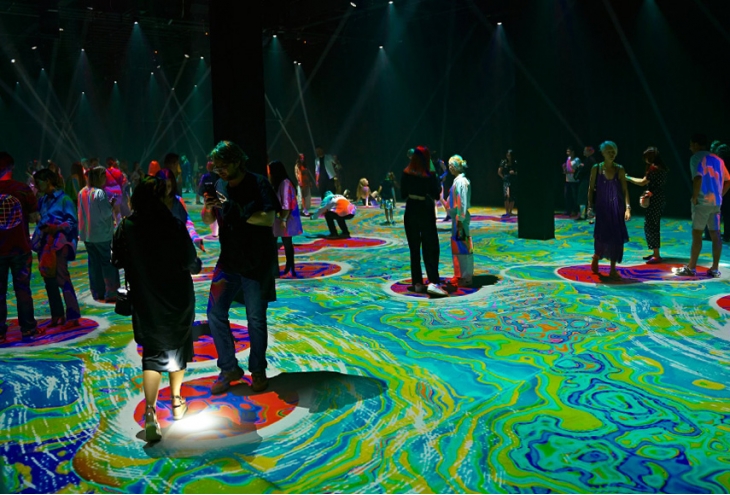

Технология трекинга мультимедиа широко известна в индустрии и часто применяется для создания шоу. Одной из самых популярных в мире систем трекинга является BLACK TRAX (познакомиться с примерами ее применения можно здесь). Например, её постоянно использует Cirque du Soleil, а порой можно увидеть и на ледовых шоу Навки (не раз лично сдавал туда в прокат).

Основа системы трекинга – это ИК (инфракрасные) датчики, за которыми наблюдают ИК-камеры. Данные о положении датчиков обрабатываются специальным сервером трекинга и передаются на мультимедиа сервер. Он, в свою очередь, управляет всем мультимедиа-пространством (свет, экраны, проекция, лазеры, кинетика и так далее), а благодаря данным о положении ИК-датчиков, управление становится во многом автоматическим.

Церемония открытия «Неделя звёзд хоккея», состоявшаяся в 2017 году в Астане, made by dreamlaser for StarProject (продюсер проекта я – Евгений Степанов). Здесь проекция на лёд, благодаря системе трекинга BLACK TRAX, за четырьмя хоккеистами в контенте генерируются «трейлы», длина которых зависит от скорости движения.

Касательно проекции, трекинг работает так: мультимедиа сервер знает где находится датчик в реальном пространстве и связывает его положение с генеративным контентом, выводящимся в проекции. Естественно есть физические и технологические ограничения, например, на больших скоростях трекинг проекции затруднён. Это связано со скоростью передачи сигнала: датчик-камера-сервер трекинга-мультимедиа сервер-проектор. Но самым слабым звеном всегда являлся именно проектор, ведь, как правило, он выдаёт изображение со скоростью 30–60 кадров в секунду.

Пока проблема с трекингом проекции кажется неочевидной?

Читайте дальше и офигеете….

Но как это работает с баскетбольным мячом?

Если вы думаете, что делать проекцию на порхающий в руках баскетболиста мяч – очевидно и легко, то вы заблуждаетесь. На кадрах этого видео запечатлено буквально НЕВОЗМОЖНОЕ и НЕПОВТОРИМОЕ.

Здесь используется специальная система, разработанная в секретных лабораториях Panasonic:

- На мяч нанесена МЕТКА (узор из специальной невидимой краски, отражающей инфракрасное излучение).

- В сторону мяча от проектора смотрит излучатель ИК-излучения.

- Совместно с проектором установлена ИК-камера, фиксирующая отраженный ИК-свет с частотой 950 кадров в секунду.

- Данные о изменении положения метки мгновенно обрабатываются, на медиасервере (объединённом с проектором) генерируется контент, который передаётся проектору для вывода.

- Специальный проектор, способный выводить контент с частотой 1920 кадров в секунду (против 60 кадров в секунду у любого другого современного проектора), транслирует контент на отслеживаемый объект.

Таким образом, мы получаем возможность отслеживать объект любой формы и размера, перемещающийся с любой скоростью, и при этом выводить на него проекционный контент. Канадская команда Moment Factory уже несколько лет выступала креативным партнером Panasonic во время разработки и тестирования данной технологии, запуск которой планировался к Олимпийским играм в Токио 2020.

Далее мы углубимся в технологию, историю её возникновения и первоисточники. Впереди много видео-кейсов.

С чего начинался Hi-speed tracking and projection mapping. Dynamic projection Mapping

С исследовательского проекта лаборатории Ishikawa Group Laboratory (посмотрите их YouTube, тут люди занимаются настоящим техно-искусством) и первых публикаций о достигнутых результатах в 2015–2016 годах: Dynamic projection mapping, DynaFlash, Deformable Dot Cluster Marker.

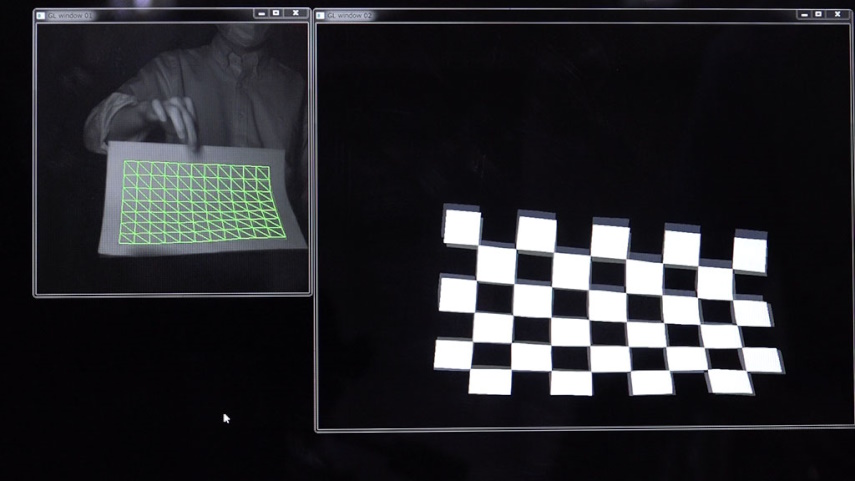

Целью исследования стал динамический мэппинг: отображение проекции на гибкий объект, изменяющийся в реальном времени. Для этого был разработан высокоскоростной проектор DynaFlash, который может проецировать 8-битные изображения (256 цветов) с частотой до 1000 кадров в секунду с задержкой 3 миллисекунды.

DynaFlash использует цифровое микрозеркальное устройства (DMD), светодиоды высокой яркости, оригинальный модуль интерфейса связи, устанавливаемый в компьютере, и передающий изображения с высокой скоростью. Это уменьшает задержку генерации изображения для проецирования до 3 миллисекунд.

Для трекинга проекционной поверхности используется система меток Deformable Dot Cluster Marker. Положение меток определяется системой камер с высокой частотой кадров. Каждая камера работает независимо друг от друга и в параллельных потоках. В итоге система генерирует изображения, основанные на данных трекинга, и проецирует их в режиме реального времени с использованием высокоскоростного проектора DynaFlash.

Метки рисуются на гибком объекте инфракрасными чернилами. Они не видны для человека, но обеспечивают устойчивую видимость (имеется в виду специальной камере), независимо от проецируемого изображения. В данной технологии и проекция, и считывание меток работают со скоростью 1000 кадров в секунду. Поэтому проецируемое на гибкую поверхность изображение выглядит, как напечатанное или существующее в качестве оригинальной текстуры объекта.

Где ещё засветился Hi-speed tracking and projection mapping. Face Hacking

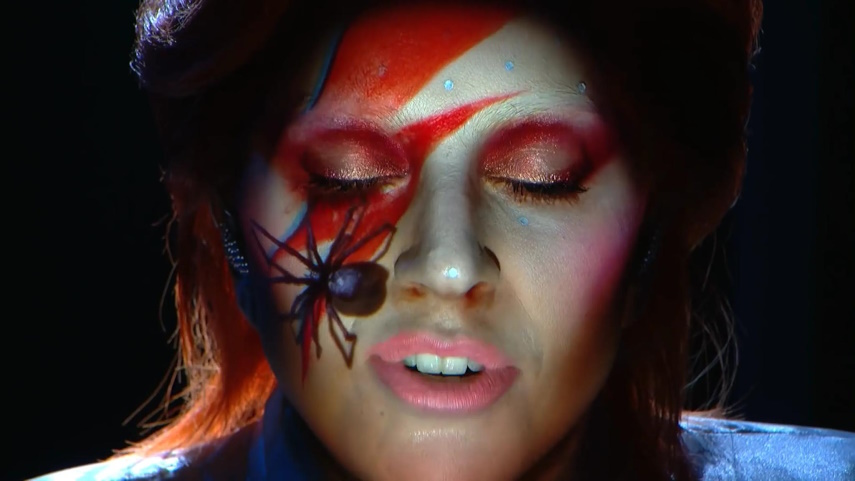

Магистр лицевого мэппинга Нобумичи Асаи открыл миру это направление в 2014 году видео-роликом OMOTE, который породил целую волну запросов «повторить на EVENT». Здесь на лице перформера приклеены ИК-метки, за ними следят ИК-камеры, и сервер выводит на проектор изображение виртуального лица, где положение «виртуальных меток» совпадает с ИК-метками на лице.

И хотя это именно видеоролик, где все шероховатости сглаживались, а съёмки шли до идеального результата, мы можем заметить, что проекция не поспевает за движением лица. Наиболее отчётливо это видно при съёмке живого мероприятия – выступления Lady Gaga на 58th Annual Grammy Awards. Здесь креативным и техническим директором также выступал Нобумичи Асаи, применивший свою систему трекинга лица.

А вот уже в 2017 году коллаборация Нобумичи Асаи с Ishikawa Group Laboratory породила кейс INORI (это, кстати, ссылка на статью из лаборатории, а не просто видосик), в котором перформеры могли двигать головой с любой скоростью, при этом проекция стала «второй кожей».

Здесь уже использовался высокоскоростной проектор DynaFlash, о котором шла речь выше. Частота 1000 кадров в секунду позволила так быстро менять положение проекции на движущемся лице, что несоответствия при резких движениях не видны ни глазу, ни обычной камере. Однако, посмотрите, как выглядел бэкстейдж. Это всё-таки решение не для массовых событий, а только для арт-проектов или съёмок.

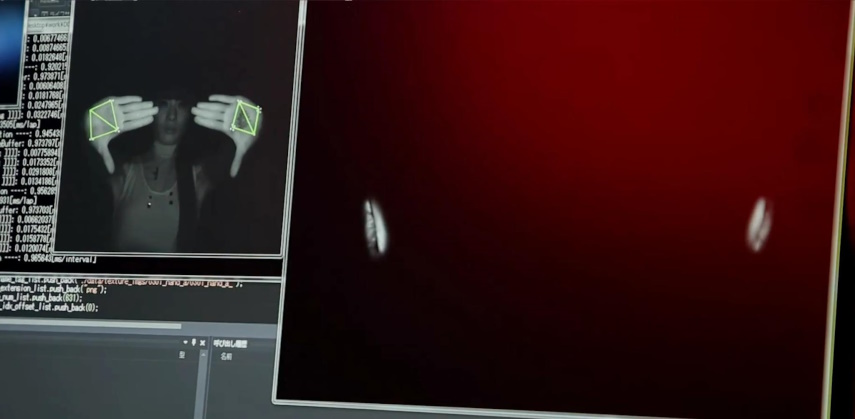

Здесь, благодаря технологиям Ishikawa Group Laboratory, на ладонях перформеров располагались ИК-узоры. И на мелькающие в воздухе ладони также проецировался мэппинг (по ссылке видео о том, как создавался этот кейс).

В том же 2017 году, в той же лаборатории, но уже со второй версией высокоскоростного проектора DynaFlash проводились тесты с мэппингом на одежду. А это, наверное, самый частый запрос в практике компании, профессионально практикующей мэппинг, ответ на который «однозначно нет!». Но вот что у них получилось благодаря ИК-узорам и высокоскоростному проектору.

А в 2018 году началось такое, что и представить, и описать сложно (на тот момент)! Динамический мэппинг без маркеров, меток и 3D-моделей, который позволяет в режиме реального времени визуально изменить фактуру материала, на который идёт проекция (MIDAS Projection).

В 2024 эту штуку нам показывают в куче XR|AR-приложений. Но это, конечно, не так впечатляюще, как 6!!! лет назад (2018) и в проекции.

Panasonic и Олимпийские игры в Токио 2020

В 2018 году Ishikawa Group Laboratory перестала публиковать информацию касательно Dynamic projection Mapping, но на сайте Panasonic появились материалы очень похожие на продолжение этой работы. Так мы можем по косвенным признакам сделать вывод, что Panasonic решила поставить эту самую исследовательскую работу на коммерческие рельсы под эгидой Олимпийских игр в Токио 2020.

В 2018 году Panasonic опубликовал статью с описанием их новой разработки Long-range TOF Image Sensor – камеры, которая различает объекты ночью и в тумане на расстоянии до 250 метров, а в 2020 году статью о том, что этот сенсор теперь умеет различать глубину, то есть определять позицию видимых объектов, их размер, форму, расстояние и так далее. Есть все основания полагать, что этот точный и высокоскоростной сенсор лёг в основу системы трекинга, разговор о которой мы начали в начале статьи и которой статью завершим.

В марте 2019 года в рамках события «500 дней до Олимпийских игр 2020» (500 Days to Go!) Panasonic продемонстрировал свою новую технологию Real-time tracking + projection mapping. Система была разработана бизнес-подразделением Media Entertainment в компании Panasonic Connected Solutions. Также упоминалось, что они начали разработку системы в 2015 году. Главный акцент разработки — это скорость проекторов, в отличие от стандартного подхода конкурентов.

Система состоит из проектора, инфракрасного излучателя и высокоскоростной камеры. Инфракрасный свет излучается на маркер, его отражение улавливается камерой. Местоположение маркера рассчитывается в процессоре, встроенном в проектор. Проектор мгновенно проецирует изображения со скоростью 1920 кадров в секунду. Так задержка с момента обнаружения информации о местоположении до проецирования контента составляет 0,0016 секунды. Заметьте, проектор обрабатывает всю информацию непосредственно в себе, минуя медиасервер.

Вот тот самый перфоманс, на котором проводилась демонстрация, просветная сетка-экран и один проектор.

Кроме этого перфоманса, на этом же событии проводились эксперименты с пинг-понгом, футболом и бейсболом (видео удалены с YouTube). В отличии от привычных нам систем трекинга, нигде не используются датчики. Все объекты трекинга оснащены пассивными инфракрасными метками.

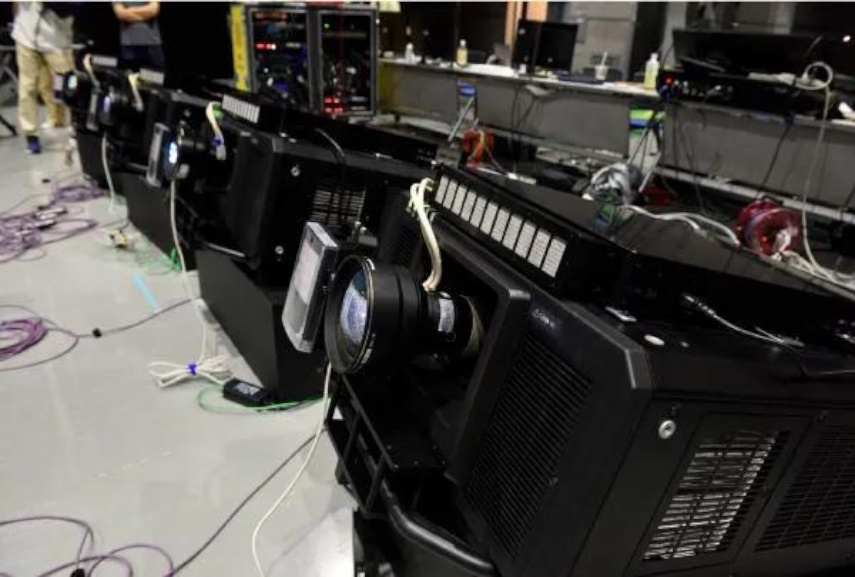

В последствии, 24 июля 2019 года, в рамках Tokyo International Forum состоялась церемония 1 Year to Go! (здесь ссылка на интересную статью Panasonic). Перфоманс исполняла гимнастка, стоящая за проекционной сеткой-экраном. Экран значительно больше, чем в прошлый раз, и впервые специалисты Panasonic свели вместе сразу 4 проектора (один из них на бэкапе).

Следующая демонстрация технологии состоялась на международной выставке потребительской электроники CES 2020 в Лас-Вегасе, где объектом трекинга снова стал мячик для пинг-понга.

Всё это время, начиная с 2017 года, канадская компания Moment Factory выступала партнером Panasonic в части креатива, контента, поиска способов применения этой новой технологии. А их совместная миссия – объединить спорт, технологии и мэппинг – становится реальностью. Отсюда и кейс Interactive Basketball Court, реализованный в июне 2020 года (здесь ссылка на кейс на сайте, а здесь ссылка на статью о работе над кейсом от лаборатории MF).

Обратите внимание насколько красивой и впечатляющей становится технология, если с ней работают творческие мультимедийные профессионалы.

Другая ветка развития «того самого» трекинга. Спортивная статистика и дополненная реальность

Та же самая технология высокоскоростного трекинга без датчиков, но уже в отсутствии проекторов, была интегрирована в прямую трансляцию Fuji TV Кубка мира по волейболу в сентябре 2019 года.

Здесь система в режиме реального времени рассчитывает траекторию, скорость, высоту, угол и другие параметры полёта мяча. Данные обрабатываются внутренними системами визуализации и накладываются на видеотрансляцию в режиме реального времени.

«Так волейбол становится интереснее для зрителей, но самое главное – итоговое видео помогает определить результативность и участие спортсменов во время мачта, провести работу над ошибками и собрать самую точную статистику».

Такой вот рекламный текст. А почему это до сих пор не везде-везде в спорте, я не понимаю. Наверное, виной всему консерватизм и закостенелость отвечающих за спорт и трансляции, но постепенно всё меняется, а вы теперь знаете чего ждать и откуда оно всё пошло.

Ярких вам впечатлений и новых открытий!